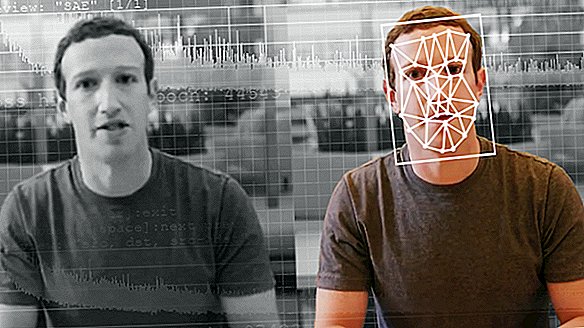

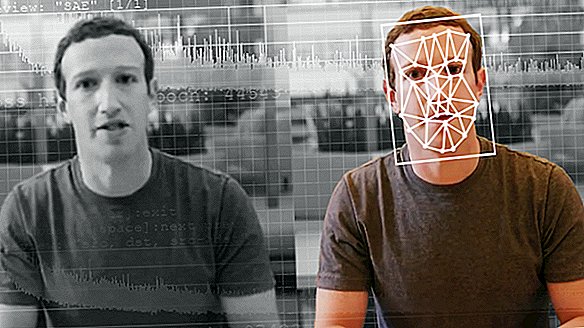

Από όλες τις τρομακτικές δυνάμεις του Διαδικτύου, η ικανότητα να ξεγελάσουν το ανυποψίαστο μπορεί να είναι το πιο τρομακτικό. Το Clickbait, φωτογραφίες με φωτογραφίες και ψευδείς ειδήσεις είναι μερικοί από τους χειρότερους παραβάτες, αλλά τα τελευταία χρόνια έχουν δει και την άνοδο ενός νέου δυνητικά επικίνδυνου εργαλείου που είναι γνωστό ως deepfake τεχνητή νοημοσύνη (AI).

Ο όρος deepfake αναφέρεται σε πλαστά, βίντεο και ήχου που παράγονται από υπολογιστή και τα οποία είναι δύσκολο να διακριθούν από το γνήσιο, αμετάβλητο περιεχόμενο. Είναι να κινηματογραφήσει τι είναι το Photoshop για εικόνες.

Πώς λειτουργεί το deepfake AI;

Το εργαλείο βασίζεται σε αυτά που είναι γνωστά ως γενετικά δίκτυα αντιπαράθεσης (GAN), μια τεχνική που εφευρέθηκε το 2014 από τον Ian Goodfellow, Ph.D. φοιτητής που εργάζεται τώρα στην Apple, Δημοφιλής Μηχανική ανέφερε.

Ο αλγόριθμος GAN περιλαμβάνει δύο ξεχωριστά AI, ένα που δημιουργεί περιεχόμενο - ας πούμε, φωτογραφίες ανθρώπων - και έναν αντίπαλο που προσπαθεί να μαντέψει αν οι εικόνες είναι πραγματικές ή ψεύτικες, σύμφωνα με το Vox. Το AI που δημιουργεί ξεκινάει χωρίς σχεδόν καμία ιδέα πώς βλέπουν οι άνθρωποι, που σημαίνει ότι ο σύντροφός του μπορεί να διακρίνει εύκολα τις αληθινές φωτογραφίες από τις ψεύτικες. Αλλά με την πάροδο του χρόνου, κάθε τύπος AI παίρνει προοδευτικά καλύτερα και τελικά ο δημιουργός AI αρχίζει να παράγει περιεχόμενο που μοιάζει άψογα με τη ζωή.

Παραδείγματα Deepfake

Τα GAN είναι εντυπωσιακά εργαλεία και δεν χρησιμοποιούνται πάντα για κακόβουλους σκοπούς. Το 2018, μια ζωγραφική που παράγεται από το GAN και μιμείται το ολλανδικό "παλιό δάσκαλο" στιλ καλλιτεχνών, όπως ο Rembrandt van Rijn του 17ου αιώνα, που πωλήθηκε στο δημοπρατήριο της Christie για ένα απίστευτο $ 432.500.

Την ίδια χρονιά, οι βαθιές φάρσες αυξήθηκαν σε ευρεία προβολή, κυρίως μέσω ενός χρήστη του Reddit που πήγε με το όνομα 'deepfakes', ανέφερε ο Vice. Η τεχνική GAN χρησιμοποιείται συχνά για να τοποθετούν τα πρόσωπα των διάσημων διασημοτήτων - συμπεριλαμβανομένων των Gal Gadot, Maisie Williams και Taylor Swift - πάνω στα σώματα πορνογραφικών ταινιών.

Άλλα GAN έχουν μάθει να λαμβάνουν μια εικόνα ενός ατόμου και να δημιουργούν αρκετά ρεαλιστικές εναλλακτικές φωτογραφίες ή βίντεο αυτού του προσώπου. Το 2019, ένας βαθύς οπαδός θα μπορούσε να δημιουργήσει ανατριχιαστικές αλλά ρεαλιστικές ταινίες της Mona Lisa που μιλάνε, κινούσαν και χαμογελούσαν σε διάφορες θέσεις.

Οι Deepfakes μπορούν επίσης να αλλάξουν το περιεχόμενο ήχου. Όπως αναφέρθηκε από το The Verge νωρίτερα αυτό το έτος, η τεχνική μπορεί να συνδυάσει νέες λέξεις σε ένα βίντεο ενός ατόμου που μιλάει, κάνοντας να φανεί ότι είπαν κάτι που ποτέ δεν είχαν την πρόθεση να.

Η ευκολία με την οποία μπορεί να αναπτυχθεί το νέο εργαλείο έχει δυνητικά τρομακτικές διακλαδώσεις. Αν κάποιος, οπουδήποτε μπορεί να κάνει ρεαλιστικές ταινίες που δείχνουν μια διασημότητα ή πολιτικό μιλώντας, κινούμενοι και λέγοντας λέξεις που δεν είπαν ποτέ, οι θεατές αναγκάζονται να γίνουν πιο επιφυλακτικοί στο περιεχόμενο στο διαδίκτυο. Για παράδειγμα, ακούστε τον Πρόεδρο Ομπάμα να προειδοποιεί ενάντια σε ένα "εξευγενισμένο" δυστοπικό μέλλον σε αυτό το βίντεο από το Buzzfeed, το οποίο δημιουργήθηκε χρησιμοποιώντας το deepfake από τον σκηνοθέτη Jordan Peele.